Articles

Loading…

Articles

LLM2CLIP:以大语言模型重塑跨模态表征学习的文本基石

在跨模态表征学习中,将不同模态的信号映射至统一的共享表示空间,进而驱动检索、理解与生成等一系列下游任务,是其核心目标。 而文本在所有模态中具有天然的独特性。它不仅是一种输入信号,更是人类对世界进行结构化认知、梳理概念体系以及开放世界知识的载体。正因为此,文本监督的质量,往往决定了跨模态表征空间的上限。更强大的文本监督信号能够引导模型在对齐过程中,学习到更复杂、更细粒度,也更具语义结构的表征空间。…

Articles

WaferLLM:从系统软件视角重构晶圆级AI计算

编者按:当“更大、更快、更高效”的 AI 计算成为业界追求的方向,在硬件革新之外,系统软件层的突破同样关键。微软亚洲研究院与爱丁堡大学联合提出的 WaferLLM 正是这一探索的重要尝试。该研究聚焦于晶圆级 AI 计算平台的系统软件优化,从架构原理到推理性能全面重构,为 AI 计算的未来提供新的视角。相关论文已被 OSDI 2025 接收。 随着 AI 模型规模持续膨胀、计算复杂度急剧上升,传统芯…

Articles

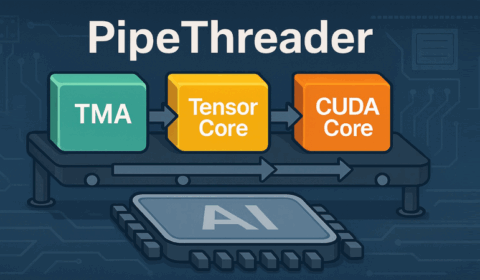

PipeThreader:让AI芯片“各司其职”的智能流水线编译器

编者按:当大模型的规模不断突破极限,AI 训练的算力需求也在以指数级攀升。传统 GPU 已难以兼顾性能与能效,异构 AI 芯片逐渐成为新趋势。但如何让不同计算单元“协同作战”,仍是编译领域的一大难题。北京大学、微软亚洲研究院、帝国理工学院与上海交通大学联合团队研发的 PipeThreader 系统,旨在解决这一核心挑战。PipeThreader 首次提出“流水线导向编译”理念,让编译器能够像“流水…